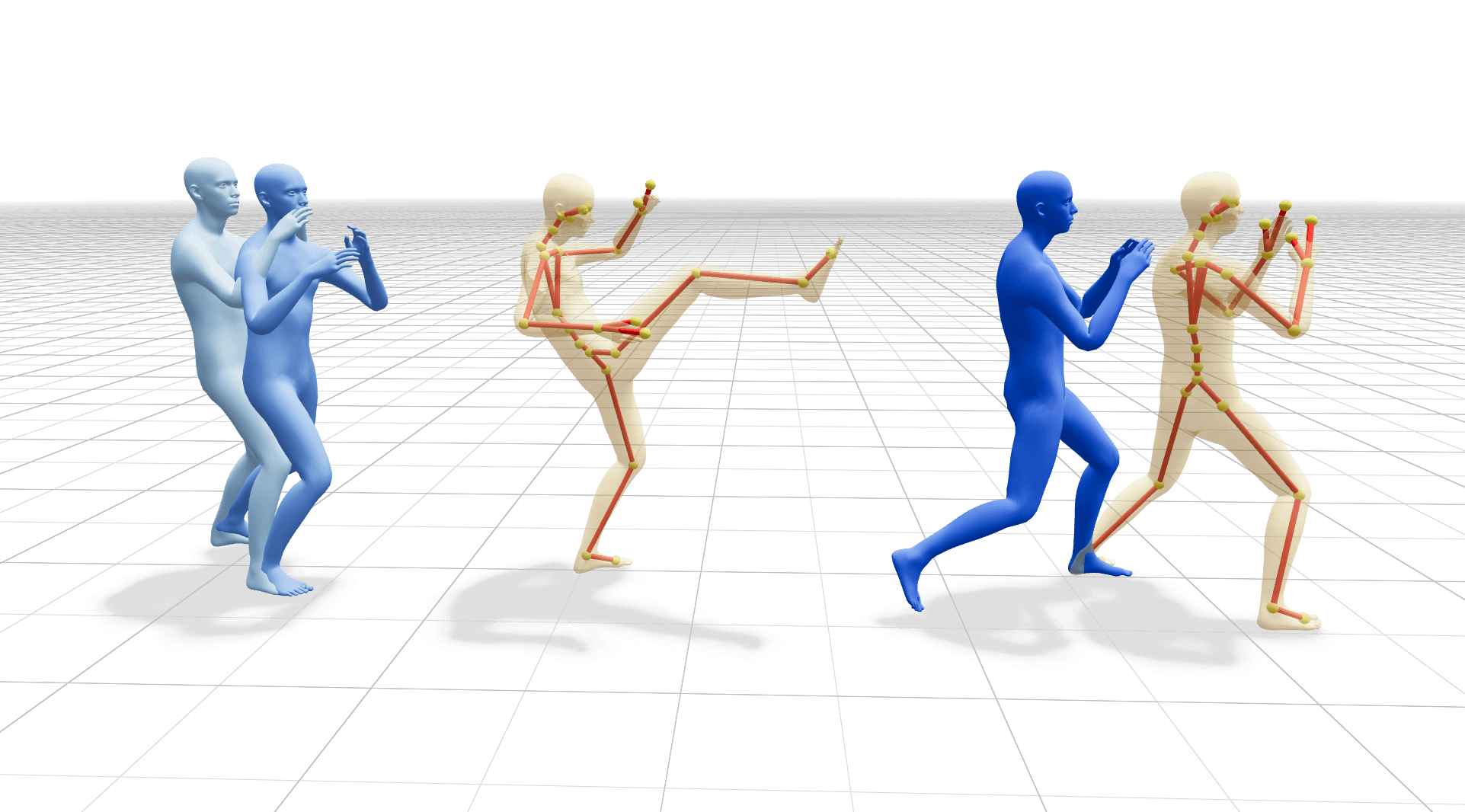

NVIDIA Spatial Intelligence Labが、テキスト指示で人体やロボットの動きを生成できるAIモーション生成モデル「Kimodo」を発表しました。なんと700時間分という大規模な光学モーションキャプチャデータで学習されており、これまでにない高品質なモーション生成が可能とのことです。

【Kimodとは】背景説明

Kimodoは「kinematic motion diffusion」の略で、拡散モデル技術を使って3D人体やロボットのモーションを生成するAIモデルです。従来のモーション生成AIは小規模なデータセットで学習されていたため品質や制御精度に限界がありましたが、Kimodoは700時間という大規模データで学習することで、これらの課題を解決しています。

Kimodoの主要機能とポイント

- テキストからモーション生成:「歩く」「踊る」「ジャンプする」などの自然言語指示で直感的にモーション制御が可能

- 多様な制約条件対応:全身キーフレーム、関節位置・回転、2Dウェイポイント、2D経路など柔軟な制約指定をサポート

- 700時間の大規模学習データ:従来の公開モーションキャプチャデータセットを大幅に上回る規模で学習

- 2段階ノイズ除去アーキテクチャ:ルート(根元)と身体の予測を分離することで、モーションアーティファクトを最小化

- 幅広い動作対応:歩行、物体操作、ダンス、スタント、ジェスチャー、スタイル化モーションなど多彩な動作生成

- 連続プロンプト対応:複数のテキスト指示を組み合わせた複雑な動作シーケンスも生成可能

技術的な特徴と革新性

Kimodoの最大の特徴は、従来のモーション生成AIが抱えていたスケールの問題を解決した点です。公開されているモーションキャプチャデータセットは比較的小規模で、生成されるモーションの品質や制御の正確性、汎化性能に課題がありました。

NVIDIAの研究チームは、慎重に設計されたモーション表現と2段階のノイズ除去アーキテクチャを採用することで、大規模データを効果的に活用。ルートモーション(全体の移動)と身体の動きを分離して予測することで、より自然で滑らかなモーション生成を実現しています。

また、実験では大規模データセットを使った検証も行われており、データセット規模とモデルサイズが性能に与える影響についても詳細に分析されているとのことです。

楽園からのひとこと

700時間分のモーションキャプチャデータで学習というスケールの大きさに圧倒されますね。テキストで「こう動いて」と指示するだけで高品質なモーションが生成できるなら、アニメーション制作やゲーム開発の現場が大きく変わりそうです。特にロボットにも対応している点が興味深く、将来的にはリアルなロボットの動作制御にも応用できるかもしれません。