※ 本記事は上記出典をもとに、CGParadise編集部が独自に解説・編集したものです。詳細は元記事をご確認ください。

Metaが動画内の物体切り抜きAIモデル「SAM 3」をアップデート。新バージョン「SAM 3.1」では複数オブジェクトの同時追跡能力が大幅に向上し、処理速度が最大8倍まで高速化されたとのことです。映像制作における手作業のマスク作業が劇的に効率化される可能性があります。

【SAM 3とは】動画内オブジェクトを自動で切り抜くAIモデル

SAM 3は、テキストプロンプトやクリック操作で動画内の特定オブジェクトを指定すると、AIが自動でそのオブジェクトを検出・追跡・切り抜きしてくれるモデルです。例えば「犬」や「黄色いスクールバス」といった簡単な指示だけで、動画全体を通してそのオブジェクトのマスクを生成できる画期的なツールとなっています。

SAM 3.1の改善ポイント

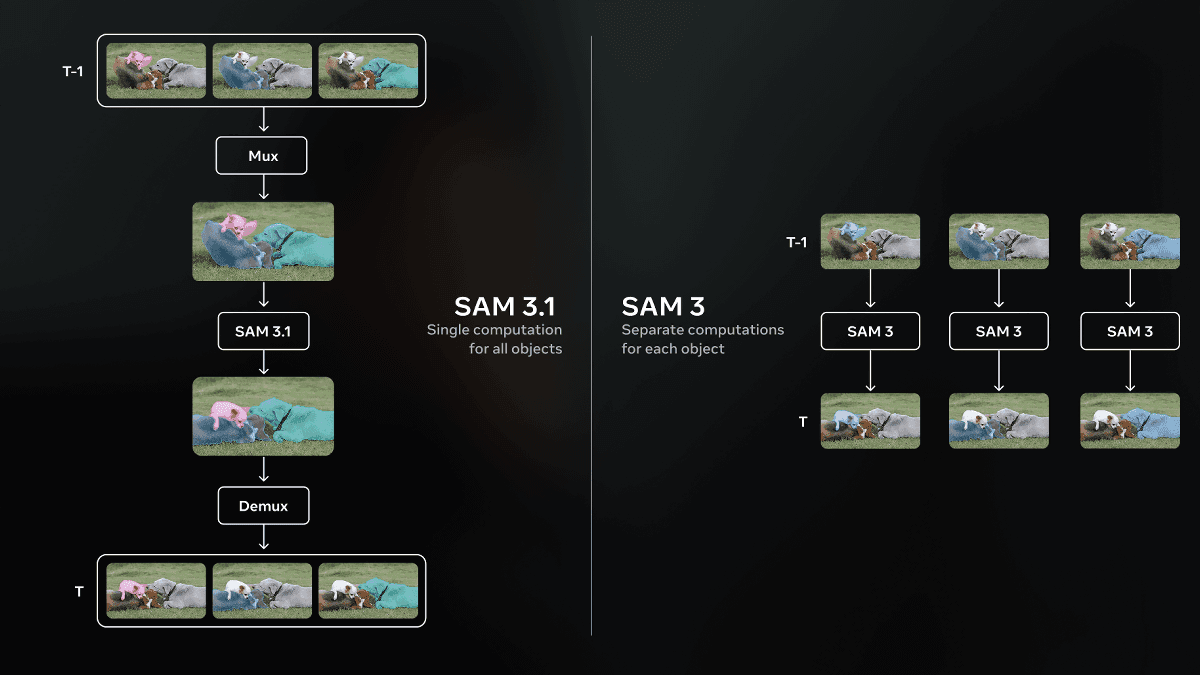

- オブジェクト多重化技術を導入

従来は追跡したいオブジェクトごとに個別処理が必要でしたが、SAM 3.1では単一のフォワードパスで最大16個のオブジェクトを同時追跡可能に。これにより冗長な計算処理が大幅削減されました。 - 処理速度が2倍〜8倍に向上

H100 GPU環境では、中程度のオブジェクト数で毎秒16フレームから32フレームへと2倍高速化。オブジェクト数が128個の場合は実に7〜8倍もの性能向上とのこと。 - 精度を維持したまま効率化

高速化と引き換えに追跡精度が落ちることはなく、品質を保ったままパフォーマンスが向上している点が重要です。

映像制作現場への影響を考える

CGParadise的には、この技術は映像制作ワークフローを根本から変える可能性があると思います。従来、After EffectsやDaVinci Resolveで複数の人物や物体を同時にマスクする際は、手作業でのロトスコープやキーイング作業が膨大な時間を要していました。

特に注目したいのは、同時に16個ものオブジェクトを追跡できる点です。例えば群衆シーンで個々の人物を分離したり、アクションシーンで複数の小道具を同時に合成用素材として抜き出したりといった用途で、従来の何倍もの効率化が期待できそうです。

また、リアルタイム性の向上により、撮影現場でのオンセットVFXプレビューや、配信・ライブ映像での即座なエフェクト適用なども現実的になってくるでしょう。映像制作の「待ち時間」が大幅に短縮される未来が見えてきます。

現在SAM 3.1のモデルはHugging Faceで公開されているとのことなので、技術的に詳しい方であれば実際に試してみることも可能です。ただし、一般的な映像制作ツールとの統合はまだこれからの段階と思われるため、BlenderやAfter Effectsなどでネイティブに使えるようになるには少し時間がかかりそうです。

楽園からのひとこと

正直、この処理速度の向上は予想以上でした。特に128個オブジェクトで8倍速って、もはや次元が違いますね。個人的には、インディー映画制作者やYouTuberクリエイターにとって、これまで予算的に諦めていた複雑なVFXが手の届く範囲になる可能性を感じています。AI技術の民主化がまた一歩進んだと思います。

出典

GIGAZINE「Metaが動画内の物体を切り抜くAIモデル「SAM 3」の複数オブジェクトの追跡能力を向上した「SAM 3.1」をリリース」